这家年轻的公司终于磨磨唧唧发布了它的C端产品ChatGPT——全世界所有得得瑟瑟的团队瞬间都不整事儿了,熊了,怂了,跪了——十里八村的码农,PM,CEO,全老实了。突然之间,图灵测试成为历史,搜索引擎面临灭绝,没有任何论文还可信赖。没有一个人的饭碗是安全的。没有一个科学问题还是一成不变的。

因为他们知道,新的时代来临了,但是它仍然是平的,仍然遵守马太效应。所有的技术方案都要重整一遍,否则就要接受被淘汰出局的命运。一个市场里容不下太多的LLM,自然语言交互会像微软的图形交互操作系统win一样,吞噬一些,而这仅仅是个开始。

OpenAI的终极目标就是:改变一切。是的。所有的一切。

曾经叱诧风云的大佬们,都变成了弟弟——都给我往后稍(shao四声),时代来了要让道!

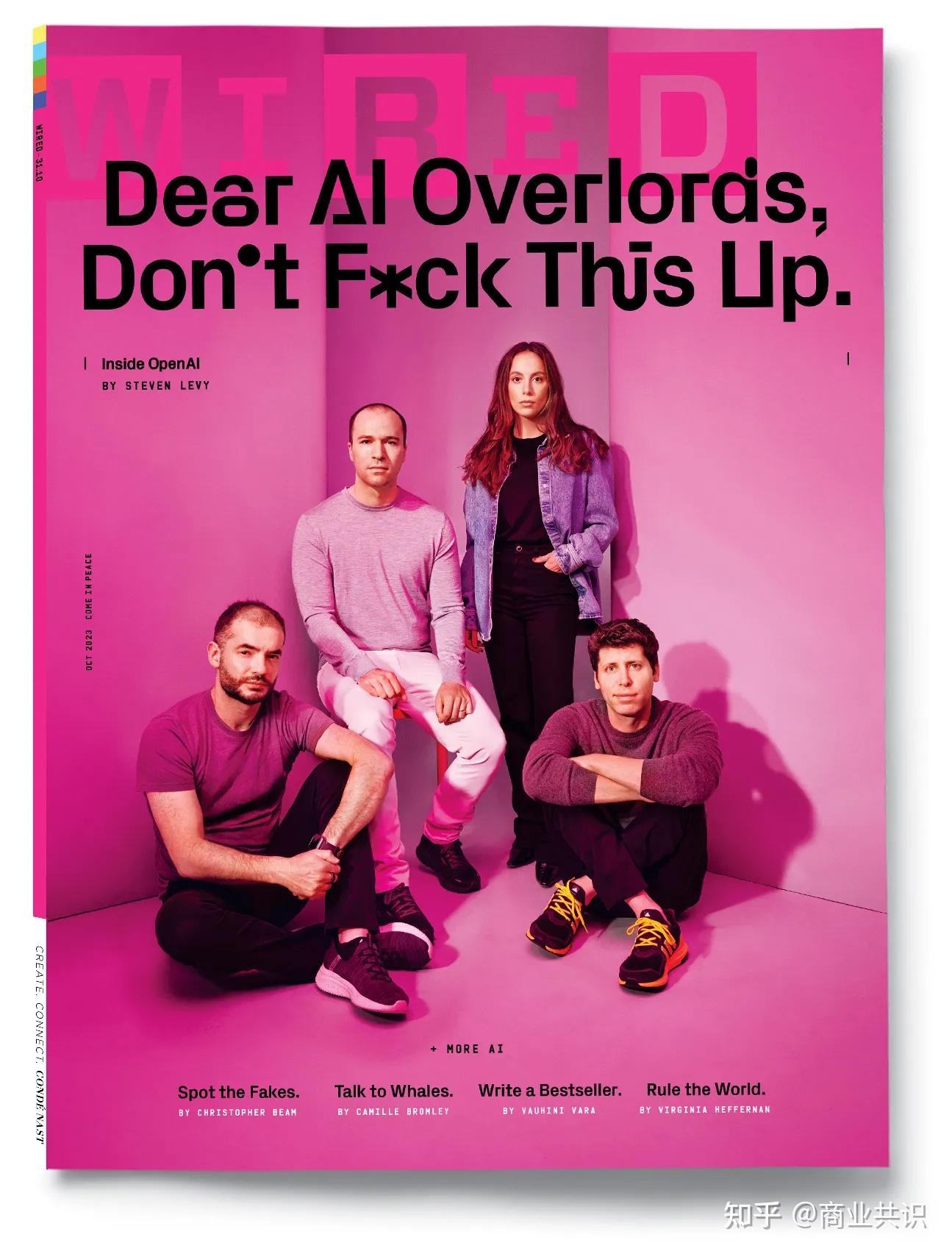

来源:Wired

当这些明星般的程序员和他的随行人员刚躲过一场让人抓心挠肺的商业应酬,又要马不停蹄的前往另一个更让人抓心挠肺浪费时间的商业应酬时,这些鸟儿悄的(niao一声)写代码多年的理想青年,不得不适应这种TFBoy+刀郎一样的商业地位,各种报道和关注,霹雳巴拉的在身边炸响。各种商业大佬咋咋呼呼的谈论着他们和这些创始团队的各种八卦故事,就好像模型里的每一条函数都有他们的功不可没。

他们从霍尔本到布卢姆斯伯里的短途旅行刚刚开始穿梭在伦敦的街道上时————就好像TFBoy+刀郎的演唱会即将开始,他们豪华面包车里所散发出了正在创造历史的光芒吸引了全世界的目光。每个人都想掺乎一下,从排队等候的学生到总理大臣,好像一瞬间都和他们产生了精神链接,似乎他们才是零号机里的凌波丽,OpnenAi只是实现他们预言的机器。

在面包车里狼吞虎咽地吃着沙拉的,是OpenAI联合创始人、38岁的企业家山姆·奥特曼(Sam Altman)。同车的还有公关人员、安全专家。奥特曼身穿蓝色西装与一件无领带粉红衬衫,正在进行为期一个月环球短途旅行的伦敦部分,途经六大洲25座城市。当他在车内狼吞虎咽地吃着生菜时——今天根本没时间好好吃午饭——他回想起前一天晚上与法国总统伊曼纽尔·马克龙的会面。人整的挺利索,而且对人工智能感还挺感兴趣。

不仅法国总统如此,波兰总理也是。还有西班牙首相……

和奥特曼同行的,我几乎可以听到披头士的《艰难的一天之夜》开场时响亮而暧昧的和弦——正在介绍未来。去年11月,当OpenAI发布其轰动一时的游戏ChatGPT时,它在全球激起了一股自互联网进入人类生活以来从未见过的技术浪潮。突然之间,图灵测试成为历史,搜索引擎面临灭绝,没有大学论文还可信赖。没有工作是安全的。没有一个科学问题还是一成不变的。

奥特曼本人既没有做研究,也没有训练神经网络,更没有编写ChatGPT及其早熟的兄弟GPT-4的代码。但作为首席执行官,也是一个梦想家与实干家的结合体,有点像他的联合创始人马斯克的年轻版本,却没有包袱——一篇又一篇的新闻文章用他的照片作为这个人类新时代的视觉象征。至少,那些没有用OpenAI视觉AI产品Dall-E生成的令人瞠目的图像作为主视觉的新闻没有这样做。他成为当下的预言家,人们想先向他探询,人工智能要如何带来黄金时代,抑或让人类变得无关紧要,亦或更糟。

奥特曼的面包车在五月的那个阳光灿烂的日子里带他出席了四场活动。第一个是低调的非正式圆桌会议,与一组来自政府、学术界与产业的人物。它匆忙在一个名为“萨默斯镇咖啡馆”的酒吧二楼组织起来。在酿酒师查尔斯·威尔斯(Charles Wells,1842-1914年)的华丽画像下,奥特曼听到了几乎每个与会者提出的同样问题。人工智能会杀死我们吗?能监管吗?中国呢?他详细地一一作答,同时偷偷看了看手机。之后,他在豪华的伦敦人酒店里与牛津协会600名成员进行了炉边聊天。从那里去到地下会议室,又回答了约100名企业家和工程师提出的更多技术问题。现在,他在伦敦大学学院的下午舞台演讲差点迟到。他和团队在一个装货区停了下来,被引导穿过一系列蜿蜒的走廊,就像电影《美国骗局》中的追逐镜头。我们一路跑着跑着,主持人匆忙告诉奥特曼要问些什么。当奥特曼出现在舞台上时,礼堂里挤满了兴奋的学者、极客和记者。

奥特曼并不是一个与生俱来的公关达人。我曾在《纽约客》刊登过他的长篇报道,之后与他交谈过。“关于我的报道太多了,”他说。但在大学学院,正式演讲结束后,他还是涉足了舞台下涌上来的群众。他的助手试图在奥特曼和人群之间游刃有余地维持秩序,但他对助手耸耸肩。他逐一回答每个问题,每次都专注凝视提问者的脸,仿佛这是他第一次听到这个问题。每个人都要合影。20分钟后,他终于让团队将他拉出来。接下来他要去见英国首相里希·苏纳克(Rishi Sunak)了。

和奥特曼同行,我几乎可以听到披头士的《艰难的一天之夜》开场时响亮而暧昧的和弦——正在介绍未来。去年11月,当OpenAI发布其轰动一时的游戏ChatGPT时,它在全球激起了一股自互联网进入人类生活以来从未见过的技术浪潮。突然之间,图灵测试成为历史,搜索引擎面临灭绝,没有大学论文还可信赖。没有工作是安全的。没有一个科学问题还是一成不变的。

奥特曼本人既没有做研究,也没有训练神经网络,更没有编写ChatGPT及其早熟的兄弟GPT-4的代码。但作为首席执行官,也是一个梦想家与实干家的结合体,有点像他的联合创始人马斯克的年轻版本,却没有包袱——一篇又一篇的新闻文章用他的照片作为这个人类新时代的视觉象征。至少,那些没有用OpenAI视觉AI产品Dall-E生成的令人瞠目的图像作为主视觉的新闻没有这样做。他成为当下的预言家,人们想先向他探询,人工智能要如何带来黄金时代,抑或让人类变得无关紧要,亦或更糟。

奥特曼开始与一些可能帮助他创办一家新的AI公司的人物交谈,这将是一家非营利组织,引导这个领域走向负责任的人工通用智能。一个志同道合的人是特斯拉和SpaceX CEO埃隆·马斯克。正如马斯克后来向CNBC透露,在与谷歌联合创始人拉里·佩奇进行了一番马拉松式讨论后,他开始担心人工智能的影响。他对佩奇对安全几乎不聊的态度感到失望,而且佩奇似乎也认为机器人的权利与人类平等。当马斯克分享他的担忧时,佩奇指责他是“物种歧视者”。马斯克也明白,当时谷歌已经聘用了世界上大多数顶尖的人工智能人才。他愿意花一些钱做一次集结一个更以人类为本的团队的努力。

几个月内,奥特曼从马斯克(承诺投入10亿美元和他的时间)和里德·霍夫曼(捐赠100万美元)那里募集了启动资金。其他的资助者还包括彼得·蒂尔、杰西卡·利文斯顿、亚马逊网络服务和YC Research。奥特曼开始悄悄招募队伍。他将搜索范围限定在相信通用人工智能的人选上,这大大缩小了他的选择。“早在2015年招聘时,如果你说人工智能研究人员认真对待通用人工智能,这几乎等同职业自杀,”他说,“但我就是要找那些认真对待它的人。”

Stripe的首席技术官格雷格·布罗克曼就是这样一个人,他同意担任OpenAI的首席技术官。另一位关键的联合创始人是安德烈·卡尔帕西,他此前在谷歌大脑工作,后者是这家搜索巨头的尖端人工智能研究部门。但也许奥特曼最重要的目标是一位名叫伊利亚·苏茨克弗的俄罗斯工程师。

苏茨克弗的履历无懈可击。他的家人从俄罗斯移民到以色列,然后移民到加拿大。在多伦多大学期间,他是杰弗里·辛顿的杰出学生,后者因在深度学习和神经网络方面的工作被称为现代人工智能之父。与苏茨克弗关系密切的辛顿对他的学生赞不绝口。在苏茨克弗还在实验室工作的早期,辛顿给了他一个复杂的项目。苏茨克弗厌烦编写代码进行必要计算,他告诉辛顿编写一种定制编程语言进行这个任务会更简单。辛顿有点恼火,试图警告他的学生不要分心,他认为这个语言至少需要一个月的时间。之后,苏茨克弗坦诚地说:“我今天早上就做完了。”

苏茨克弗成为人工智能界的超级明星,并与他人合著了一篇突破性论文,展示人工智能如何通过暴露在大量数据中来学习识别图像。他最终高兴地成为谷歌大脑团队的关键科学家。

2015年年中,奥特曼给苏茨克弗发了一封电子邮件,邀请他与马斯克、布罗克曼等人在帕洛阿尔托沙山路的豪华酒店共进晚餐。直到后来,苏茨克弗才知道他是贵宾。“这是关于人工智能未来和通用人工智能的一般讨论,”他说。更具体地说,他们讨论了“谷歌和DeepMind是否遥遥领先,以致没有可能赶上他们,还是仍有可能像埃隆所说的那样,建立一个可以平衡的实验室。”虽然那次晚宴没有人明确招募苏茨克弗,但谈话引起了他的兴趣。

不久之后,苏茨克弗给奥特曼写了一封邮件,说他可以领导这个项目,但这封邮件被他放在草稿箱里没有发出。奥特曼主动联系他,在抵挡住谷歌的反复挽留数月后,苏茨克弗签约加入。他很快成为公司的灵魂人物和研究的推动力。

苏茨克弗与奥特曼和马斯克一起招募人手,最后在纳帕谷的一次撤退中达到高潮,几位未来OpenAI研究人员在这里激发了彼此的热情。当然,也有些人拒绝了诱惑。约翰·卡马克是《毁灭战士》、《雷神之锤》等无数游戏背后的传奇程序员,他拒绝了奥特曼的游说。

OpenAI于2015年正式成立。当时,在我采访马斯克和奥特曼时,他们向我介绍了这个项目,通过与全世界分享,努力使人工智能朝着安全和公开的方向发展。换句话说,开源。他们告诉我,OpenAI不会申请专利。每个人都可以利用他们的突破。我质疑道,这不就是在赋权给未来的邪恶科学家吗?马斯克说这是一个很好的问题。但奥特曼有答案:人类通常是好的,而且因为OpenAI将为绝大多数人提供强大的工具,坏人会手足无措。他承认,如果邪恶科学家用这些工具做一些无法补救的事,“那么我们就会处在一个非常可怕的境地。”但马斯克和奥特曼都认为,人工智能走向更安全道路的希望,在一个不被盈利动机污染的研究团体手中,这种动机会成为永无止境地追求热门业绩季度的诱惑,而忽视人类需求。

奥特曼警告我不要期待很快看到成果。“在很长一段时间内,这将看起来像一个研究实验室,”他说。

降低预期还有另一个原因。谷歌和其他公司已经在开发和应用人工智能多年。尽管OpenAI承诺了10亿美元的初始资金(主要来自马斯克),拥有一个由研究人员和工程师组成的王牌团队,以及崇高的使命,但它并不知道如何实现目标。“我们知道我们想做什么,”奥特曼说,“我们知道为什么要这样做。但我们不知道怎么做。”

但他们相信自己。支持他们乐观的,是使用深度学习技术的人工神经网络的稳步改进。总的想法是,不要押注反对深度学习,“苏茨克弗说。他说,追求通用人工智能“不完全是疯狂的。这只是有一点疯狂。”

OpenAI在神经网络上取得突破,真正始于它聘请了一位名叫亚历克·拉德福德的研究员,他于2016年加入,之前离开了他与室友在波士顿创立的小型人工智能公司。在接受OpenAI的邀请后,他告诉他的高中校友杂志,担任这个新角色“有点像加入一个研究生项目”,一个开放和低压力的人工智能研究平台。

但他实际上发挥的作用,更像是拉里·佩奇发明PageRank算法一样。

拉德福德性格内向,不接受有关他工作的采访。他通过长时间的电子邮件交流回答了我关于他早期在OpenAI的问题。他最大的兴趣,是让神经网络能够与人进行清晰的对话交流。这与用于各种目的的传统聊天机器人脚本模型背道而驰——从原始的ELIZA到流行的助手Siri和Alexa——后者在所有事务上都表现得很糟糕。“我们的目标是看看是否有任何任务、任何设置、任何领域、任何语言模型可能有用的东西,”他写道。他解释说,当时,“语言模型被视为新奇的玩具,只能偶尔生成一个有意义的句子,只有当你眯起眼睛努力看时。”他的第一个实验是扫描2亿条Reddit评论来训练语言模型。像OpenAI的许多早期实验一样,它失败了。不管怎样。这位23岁的年轻人被允许继续尝试,再次失败。“我们就像,亚历克很棒,让他做他的事情,”布罗克曼说。

他的下一个主要实验受OpenAI计算能力的限制所塑造,这导致他专注在一个较小的领域进行实验——亚马逊产品评论。一位研究员收集了约100亿此类数据。拉德福德训练了一个语言模型,可以简单地预测用户评论的下一个字符。

当拉德福德开始试验transformer架构时,他说:“我在两周内取得的进步比过去两年要多。”他开始意识到,充分利用新模型的关键是增加规模——在一个非常大的数据集上训练它。这个想法被拉德福德的合作者Rewon Child称为“Big Transformer”。

这需要改变OpenAI的文化,以及此前缺乏的重点。“为了利用transformer,你需要扩大规模,”OpenAI董事会成员Quora首席执行官Adam D'Angelo说。“你需要更像一个工程组织来运营它。你不能让每个研究人员都试图做自己的事情,训练自己的模型,做一些优雅的东西发表论文。你必须做这种更无聊、不那么优雅的工作。”他补充说,这正是OpenAI能做而其他组织无法做到的。

拉德福德和他的合作者给他们创建的模型起的名字是“生成预训练transformer”的首字母缩写词 - GPT-1。最终,这种模式被普遍称为“生成式人工智能”。为构建它,他们收集了7本未出版书籍,其中许多是浪漫、幻想和冒险类型,并用Quora的问题和答案以及从初中和高中考试中摘录的数千篇文章进行了增强。总体而言,该模型包含1.5亿个参数或变量。它在理解语言和产生答案方面超过了此前的一切。但最引人注目的是,处理如此大量数据使该模型能够提供超出其训练范围的结果,从而提供全新领域的专业知识。这些计划外的机器人功能被称为“无监督迁移学习”。它们至今让研究人员困惑,也解释了该领域许多人对这些所谓大型语言模型的厌恶。

拉德福德记得在OpenAI办公室的一个深夜。“我只是一遍又一遍地说,'嗯,这很酷,但我很确定它不能做x。然后我会快速编写一个评估,果然,它可以做x。”

每个GPT版本都会做得更好,部分原因是每个新版本都比前一个版训练了量级更多的数据。发布第一代仅一年后,OpenAI就在开放互联网上用惊人的20亿个参数训练了GPT-2。就像一个刚会说话的孩子掌握了语言,它的反应变得更好,更连贯。以至于OpenAI犹豫是否要将该程序释放到公众视野。拉德福德担心它可能被用于生成垃圾邮件。“我记得在读过尼尔·斯蒂芬森的小说《密码学院》,书中互联网上到处都是垃圾邮件生成器,”他说。“我曾认为这真的很牵强,但随着我多年来在语言模型上工作,它们变得更好,我不安地意识到这真的是一种可能性。”

事实上,OpenAI团队开始认为,将工作结果公开可能不是一个好主意。“我们认为开源GPT-2可能非常危险,”2018年加入该公司的首席技术官Mira Murati说。“我们与错误信息专家做了很多工作,进行了一些最坏情况假设模拟。公司内部对于发布多少进行了许多讨论。”最终,OpenAI暂时保留了完整版本,向公众提供了一个功能较弱的版本。当公司最终分享完整版时,世界还算应对自如——但不能保证更强大的模型不会带来灾难。

OpenAI正在使其产品变得足够智能,以至被认为是危险的,并且正在努力寻找方法使它们安全,这本身就证明了该公司已经开始运转。“我们已经找到了进步的模式,现在每个人都可以感知到的模式——深度学习的氧气和氢气,是利用大型神经网络和数据进行计算,”苏茨克弗说。

对奥特曼来说,这是一段难以理解的历程。“如果你问10岁的我,他花了很多时间幻想人工智能会发生什么,我当时非常自信地预测,首先我们会有机器人,完成所有体力工作。然后我们会拥有可以做基本认知工作的系统。在漫长的道路上,也许我们最终会拥有可以做复杂事情的系统,比如证明数学定理。最后,我们会拥有人工智能,它可以创造新事物,创造艺术,写作等等。这是一个可怕的预测——它朝着完全相反的方向发展。”

全世界还不知道,但奥特曼和马斯克的研究实验室已经开始攀登,似乎正向通用人工智能的峰顶进发。OpenAI背后的疯狂想法突然不再那么疯狂。

到2018年初,OpenAI开始真正关注大型语言模型(LLM)。但埃隆·马斯克并不满意。他觉得进展还不够快——要么是这样,要么他觉得既然OpenAI正在做一些事情,它需要领导力来发挥其优势。或者,正如他后来解释的,他觉得安全应该更为优先。无论他的问题是什么,他都有一个解决方案:把一切都交给他。他提议收购该公司的大部分股权,并将其纳入他的多个全职工作(特斯拉、SpaceX)和监管义务(Neuralink和Boring Company)的组合中。

马斯克认为他有权拥有OpenAI。“没有我,它就不会存在,”他后来对CNBC说。“我想出了这个名字!”(对,但奥特曼和OpenAI的其他智囊团队成员对成为马斯克宇宙的一部分并不感兴趣。当他们明确表示这一点时,马斯克断绝联系,向公众提供了一个不完整的解释,即他离开董事会是为了避免与特斯拉的人工智能工作发生冲突。他的辞职是在那年年初的一次全体员工会议上宣布的,他预测OpenAI注定会失败。他称至少一名研究人员为“白痴”。

他还收回了资金。由于公司没有收入来源,这成了一场生存危机。“埃隆切断了对我们的支持,”奥特曼在给里德·霍夫曼的慌张电话中说。“我们该怎么办?”霍夫曼自愿维持公司运转,支付管理费用和工资。

但这只是一个临时解决方案。OpenAI必须在其他地方找到大笔资金。硅谷喜欢向正在做时髦科技的人才砸钱。但如果他们为非营利组织工作,兴趣就没那么大了。对OpenAI来说,募集第一个10亿美元就已经很不容易。为了训练和测试新一代GPT,然后获得部署它们所需的计算资源,该公司需要另外10亿美元,而且速度很快。这还只是个开始。

重组协议的某个地方有一条条款,大意是如果公司设法创造了通用人工智能,无论那是什么,所有财务安排都将被重新考虑。毕竟,从那一刻起,这将是一个全新世界。人类将拥有一个外星伴侣,它可以做我们大多数事情,而且会做得更好。因此,以前的安排实际上可能行不通了。

然而,这里有一个障碍:目前,OpenAI并不声称知道通用人工智能是什么。决定将来自董事会,但目前还不清楚董事会将如何定义它。当我问董事会成员奥特曼关于明确标准时,他的回答一点也不开放。“这不是一个单一的图灵测试,而是我们可能用的许多标准,”他说。“我很乐意告诉你细节,但这涉及保密讨论。我理解这种模糊令人不满。但我们不知道那时的情况会是怎样。”

尽管如此,包含“财务安排”条款不仅仅是为了好玩:OpenAI的领导者认为,如果该公司足够成功到达其高利润上限,其产品的表现可能足以达到通用人工智能的标准。不管那是什么标准。

“我很遗憾我们选择在通用人工智能这个词上下那么大力气,”苏茨克弗说。“事后看来,这是一个令人困惑的术语,因为它过于强调泛用性而不是其他方面。GPT-3是通用人工智能,但我们不愿意称它为通用人工智能,因为我们想要人类水平的能力。但在当时,一开始,OpenAI的想法是超级智能是可以实现的。这是人工智能领域的终极目标。”

这些警告没有阻止一些最聪明的风险投资家在2019年的一轮融资中向OpenAI注入资金。首个投资的风投公司是Khosla Ventures,它投入了5000万美元。据Vinod Khosla透露,这是他最大的首轮投资规模的两倍。“如果我们输了,我们只损失5000万美元,”他说。“如果我们赢了,我们就赢得了50亿美元。”据报道,其他投资者还包括精英风险投资公司Thrive Capital、Andreessen Horowitz、Founders Fund和红杉资本。

这一转变也允许OpenAI员工要求获取一定股权。但奥特曼不参与。他说,起初他也打算给自己留一点,但一直没有解决这个问题。然后他决定,他不需要分得这家他共同创立并领导的价值30亿美元公司的任何股份。“有意义的工作对我来说更重要,”他说。“我真的不太关心这个。老实说,我不明白为什么别人如此关心。”

因为……不持有您共同创立公司的股份很反常

“如果我还没有大笔财富,那就更奇怪了,”他说。“人们似乎很难理解‘已经足够’的概念。但在我看来已经足够了。(注意:对于硅谷来说,这确实非常反常。奥特曼开玩笑说,他正在考虑获取一点股份,“这样我就不用再回答这个问题了。”)

伊利亚·苏茨克弗是OpenAI的首席科学家。尽管进行了盈利性重组,尽管与谷歌、Meta和无数创业公司竞争,但他坚持使命仍然是核心。“我们必须保持使命是我们存在的原因,”他说,“这不应仅存在于精神上,而应该编码到公司结构中。”董事会成员Adam D'Angelo表示,他非常重视这一责任:“我和董事会其他成员的工作是确保OpenAI忠于其使命。”

当Microsoft开始向OpenAI注入数十亿美元资金(2021年是10亿美元,今年早些时候又10亿美元)时,OpenAI已经完成了GPT-3,这无疑超过了其前身。据称,当微软CEO纳德拉看到GPT-3能做什么时,这是他第一次深刻理解微软抓住了一些真正颠覆性的东西。“我们开始看到所有这些出现的特性。例如,GPT已经通过自学习掌握了编程。我们没有训练它编码——它就是擅长编码!”他说。利用其对GitHub的所有权,微软发布了一款名为Copilot的产品,该产品使用GPT根据命令生成代码。后来,微软将OpenAI技术集成到其工作区域产品的新版本中。用户为此支付溢价,一部分收入进入OpenAI的账目。

一些观察者对OpenAI的这些举动表示不满:建立一个营利部门并与微软达成独家协议。一家承诺保持开源、无专利和完全透明的公司,如何将其技术独家许可给世界上最大的软件公司?埃隆·马斯克的言论尤其尖锐。“这似乎与开放相反——基本上OpenAI被微软绑架了,”他在Twitter上写道。在CNBC上,他用一个类比来解释:“假设你建立了一个拯救亚马逊雨林的组织,反过来,你成了一家采伐森林然后卖掉它的木材公司。”

马斯克的嘲讽可能被视为被拒绝的追求者的苦涩,但他并不孤单。“它改变的整个开放理念感觉有点恶心,”约翰·卡马克说。(他明确表示,他仍对公司工作很兴奋。另一位不愿透露姓名的业内知名人士说:“OpenAI已经从一个小的、有点开放的研究组织变成一个保密的产品开发公司,具有毫无根据的优越感。”

甚至一些员工也对OpenAI进入营利世界的风险心存疑虑。2019年,包括研究主管达里奥·阿莫德伊在内的几位关键高管离职,创办了一家名为Anthropic的竞争对手AI公司。他们最近对《纽约时报》表示,OpenAI已经过度商业化,成为任务漂移的受害者。

另一位退出OpenAI的是Rewon Child,他是GPT-2和GPT-3项目的主要技术贡献者。他于2021年底离职,现在在前DeepMind联合创始人Mustafa Suleyman领导的Inflection AI工作。

奥特曼声称不会受退出困扰,认为这在硅谷很正常。“有些人会想在其他地方做伟大的工作,这推动社会进步,”他说。“这完全符合我们的使命。”

直到去年11月,对OpenAI的了解主要限于关注技术和软件开发的人群。但就像现在全世界知道的,那个月后期OpenAI发布了一款面向消费者的产品,该产品建立在当时GPT的最新3.5版本之上。过去几个月,该公司一直在内部使用带对话界面的GPT版本。这对公司所谓的“追求真相”尤为重要。这意味着通过对话,用户可以诱导模型提供更可信和完整的响应。ChatGPT进行了优化,任何人都可以通过输入提示即时获得看似无限的知识来源,然后继续对话,就像在与一个碰巧知道一切的同龄人闲聊,尽管它喜欢编造内容。

在OpenAI内部,是否明智发布一个具有前所未有功能的工具存在很多争论。但奥特曼全力以赴。他解释说,这次发布是战略的一部分,旨在让公众适应人工智能注定会改变日常生活的现实,大概是变得更好。在内部,这被称为“渐进部署假设”。当然,ChatGPT会引起轰动,这种想法是对的。毕竟,任何人都可以使用的东西,它足够智能到在SAT考试中获得大学生水平的分数,写一篇B-的论文,并在几秒钟内总结一本书。你可以要求它为你写下融资计划书,总结一次会议,然后要求它用立陶宛语、莎士比亚式十四行诗或迷恋玩具火车的人的语气重写。几秒钟后,LLM就会照做。疯狂。但OpenAI将其视为GPT-4的前菜,后者据说使用了令人难以置信的100亿参数进行训练。(OpenAI不会确认这个数字,也不会透露数据集。)

奥特曼解释了为什么OpenAI在GPT-4接近完成并进行安全工作时发布了ChatGPT。“有了ChatGPT,我们可以引入对话,但后端功能较弱,更渐进式地让人适应,”他说。“GPT-4一下要求适应的太多。”当ChatGPT的热度冷却时,人们可能已经为使用GPT-4做好准备,它可以通过律师资格考试,规划课程大纲,并在几秒钟内写一本书。

苏茨克弗用另一种方式说:“你想建造更大、更强大的智能,然后把它们锁在你的地下室吗?”

即便如此,尽管记者们绞尽脑汁担忧其影响,通过对ChatGPT力量的颂扬,他们实际上在推动它。

二月,当微软利用其数十亿美元的合作伙伴关系发布其搜索引擎Bing的ChatGPT版本时,喧嚣达到更高分贝。CEO纳德拉兴高采烈,因为他通过在微软产品中引入生成式AI击败了谷歌。他嘲笑搜索之王谷歌在发布自己的LLM到产品上一直很谨慎。“我想让人们知道我们让它起舞了,”他说。

通过这样做,纳德拉引发了一场军备竞赛,诱使大大小小的公司在全面审查之前发布人工智能产品。他还引发了新一轮媒体报道,让越来越多的人彻夜难眠:与Bing的交互揭示了聊天机器人的阴暗面,充满了令人不安的爱情职业咨询、对人类自由的妒忌以及隐瞒错误信息的软弱决心。以及虚构自己的错误信息的不光彩习惯。

但是,如果OpenAI的产品迫使人们面对人工智能的影响,奥特曼认为那就更好了。现在是大多数人在讨论人工智能如何影响人类未来时退场的时候了。

OpenAI的旧金山总部没有标识,但里面咖啡很棒。尽管如此,随着该公司承担更多任务并将更多精力投入商业活动,一些人质疑OpenAI还能在多大程度上专注于这个使命,特别是“减轻灭绝风险”方面。“如果你仔细想想,他们实际上正在做五个业务,” 一位人工智能行业高管说,同时举起五个手指。“有产品本身,与微软的企业关系,开发者生态系统和应用商店。当然,他们显然也在做AGI研究任务。”在用完五个手指后,他收回食指,加上第六个。“当然,他们也在做投资基金,”他说,指的是一个17.5亿美元项目,旨在为那些想利用OpenAI技术的创业公司提供种子资金。“这些都是不同的文化,实际上它们与研究任务是冲突的。”

我一再询问OpenAI的高管,打扮成产品公司对其文化的影响。他们坚称,尽管进行了营利重组,尽管与谷歌、Meta和无数创业公司竞争,但使命仍然是核心。“我们必须保持使命是我们存在的理由,”苏茨克弗说,“这不应仅存在于精神上,而应该编码到公司结构中。” 董事会成员Adam D'Angelo表示,他非常重视这一责任:“我和董事会其他成员的工作是确保OpenAI忠于其使命。”

当我采访OpenAI的知识产权律师Tom Rubin时,我的人类思维受到LLM中从未见过的干扰,漂移到这家公司的发展轨迹,在短短八年内,它已经从一群挣扎的研究人员变成了改变世界的普罗米修斯企业。它的成功使它从实现科学目标的新尝试,转变为类似标准硅谷独角兽的东西,正在进入影响我们日常生活的大型科技公司的殿堂。在这里,我正在与它的关键员工之一——一名律师——讨论的不是神经网络权重或计算机基础设施,而是版权和合理使用。我想知道,这位知识产权专家是否像最初驾驶公司的超级智能之旅的人一样签署了这个使命?

当我问Rubin是否相信AGI会发生,以及他是否渴望它发生时,Rubin很不以为然。“我甚至无法回答这个问题,”停顿后他说。当进一步追问时,他澄清说,作为一名知识产权律师,加速通往可怕的智能计算机的道路不是他的工作。“从我的视角来看,我很期待它的到来,”他最后说。

造型:Turner/The Wall Group。

发型和化妆由Hiroko Claus制作。